|

하지만 이 기술만 있다면 불과 1초 만에 할머니를 찾을 수 있다. ‘꽃무늬 스웨터를 입은 채 혼자 있는 80대 여성을 찾아줘’ 혹은 ‘꽃무늬 스웨터를 입고 주변을 두리번거리며 걷고 있는 키 150㎝의 80대 여성을 찾아줘’ 등의 한 문장이면 된다. 할머니가 지금 무엇을 하고 있는지 물어보면 어느 방향으로 이동하고 있는지, 땅바닥에 주저앉아 있는지 등 상황을 설명해주기도 한다. 바로 인공지능(AI) 스타트업 트웰브랩스의 초거대 영상 이해 모델 ‘마렝고’와 ‘페가수스’ 기술이다.

영상의 ‘맥락’ 이해…시간의 흐름과 주변 상황 등 함께 학습

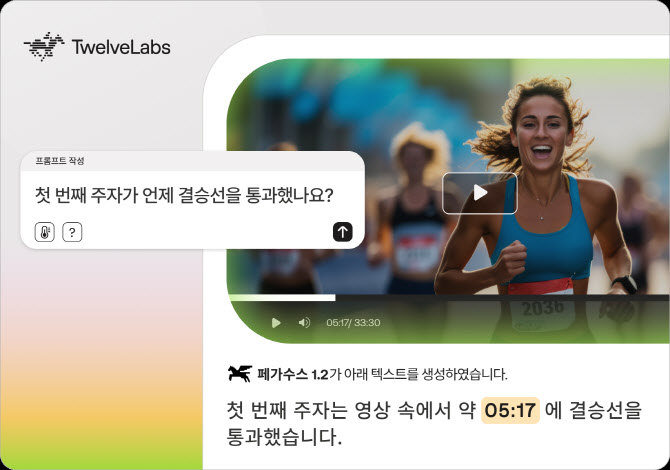

마렝고와 페가수스는 텍스트를 기반으로 한 영상 이해 모델이다. 사람이 경험하는 특정 상황 속에는 시간의 흐름과 주변 상황, 맥락, 이미지, 소리, 행동 등 수없이 많은 정보가 존재한다. 마렝고와 페가수스는 영상을 특정 시간 단위로 자른 이미지인 ‘프레임’으로 기억하지 않고 상황에 담긴 모든 정보를 종합해서 수학 함수인 벡터 표현으로 기억한다. 덕분에 시간의 변화에 따라 행동이나 상황이 어떻게 변하는지 벡터 정보들을 연결해 맥락을 이해한다. 마렝고가 텍스트를 기반으로 영상을 찾아준다면 ‘페가수스’는 영상의 맥락을 이해한 후 텍스트로 설명해준다.

이 기술들은 5초 전에는 멀쩡히 걷던 사람이 돌부리에 걸려서 넘어지고 있다거나 운전자가 버린 담배꽁초가 길가의 쓰레기 더미에서 화재를 불러일으키는 상황을 인지할 수 있다. 맥락을 이해하고 있는 덕에 불이 타오르기 시작하는 시점도 정확히 알고 있다. 마렝고는 총성이 들리는 구간을 찾아달라고 하면 총소리 오디오를 포함한 영상 구간을 찾아내기도 한다. 페가수스는 총성이 울리는 당시 상황을 설명해 줄 수 있다. 이미지와 상황은 물론 음성도 ‘텍스트’ 기반으로 똑똑하게 이해한다.

카메라 위치도 구분한다. 드론으로 찍은 각도, 사람 눈높이에서 찍은 각도, 바닥에서 위로 찍은 각도 등을 다르게 인식하는 셈이다. 만약 내가 좋아하는 연예인이 왼쪽 위에서 아래로 찍은 각도의 얼굴이 예쁘다면 해당 각도로 담은 영상 구간들을 추출할 수도 있을 것이다.

실시간 CCTV는 물론 긴 영상 속 특정 장면도 발견해

특히 마렝고는 실시간 CCTV 뿐만 아니라 1시간 이상의 긴 영상도 이해하고 사용자 요청에 반응한다. 일상을 찍은 1시간30분짜리 영상에서 재밌었던 시점을 빠르게 찾을 수도 있다. 어릴 적 체육대회에서 달리기 1등 했던 추억을 되새기고 싶다면 달리기 첫 번째 주자가 결승선을 통과하는 구간을 찾아달라고 해서 바로 해당 시점을 발견할 수 있다. 경찰은 CCTV로 범인을 잡을 때 걸리는 시간을 줄일 수 있고, 지자체는 치매 노인이나 길을 잃어버린 아이를 빨리 찾아 지역 치안에도 도움을 받을 수 있다.

트웰브랩스는 지난 2023년 우리나라 AI 스타트업으로는 처음으로 엔비디아로부터 투자를 유치했다. SK텔레콤(017670)은 지난해 말 트웰브랩스에 300만달러(약 44억원)를 투자했다. 트웰브랩스의 영상 검색 엔진은 현재 디즈니 스튜디오 등 글로벌 콘텐츠 기업의 동영상 아카이브 활용에도 쓰이고 있다.

![고맙다, 코스피!…연기금 줄줄이 '역대 최고 수익률' [마켓인]](https://image.edaily.co.kr/images/Photo/files/NP/S/2026/02/PS26021001687t.630x.0.jpg)