모티프 측은 “트릴리온랩스의 21B 모델이 메타의 라마(LLaMA)를 사실상 그대로 가져왔다”고 문제를 제기했고, 트릴리온랩스는 “가중치를 0에서 시작해 프롬스크래치로 학습한 독자 모델이며 라마는 추론 코드만 참고했다”는 입장이다. 프롬스크래치 학습은 사전 학습을 기존 모델 가중치(이미 학습된 파라미터) 없이 처음부터 수행했다는 의미다. 이번 논란은 독파모 평가에서 ‘독자성’을 어디까지로 볼 것인지, 정부가 과거 유사 사례에서 정리한 기준과의 정합성까지 건드리고 있다는 평가가 나온다.

쟁점은 ‘추론 코드 차용’인가 ‘모델 전체 복제’인가

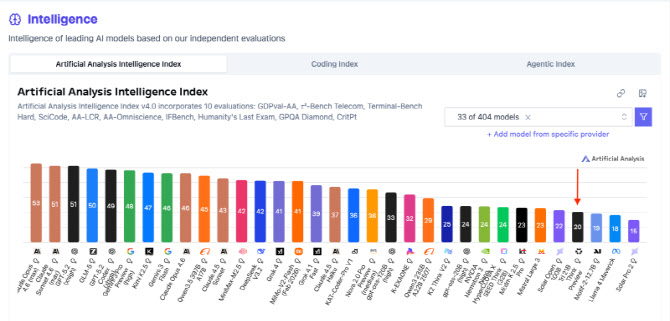

논란은 트릴리온이 이날 ‘Tri 21B Think’를 공개하면서 해당 모델이 글로벌 AI 성능 분석 기관 아티피셜 애널리시스(AA) 리더보드에서 글로벌 톱30에 등재됐다고 밝힌 뒤 확산됐다. 트릴리온은 해당 모델이 기존 ‘Tri 21B’에 강화학습을 적용해 사고 역량을 고도화한 버전이라고 설명했다.

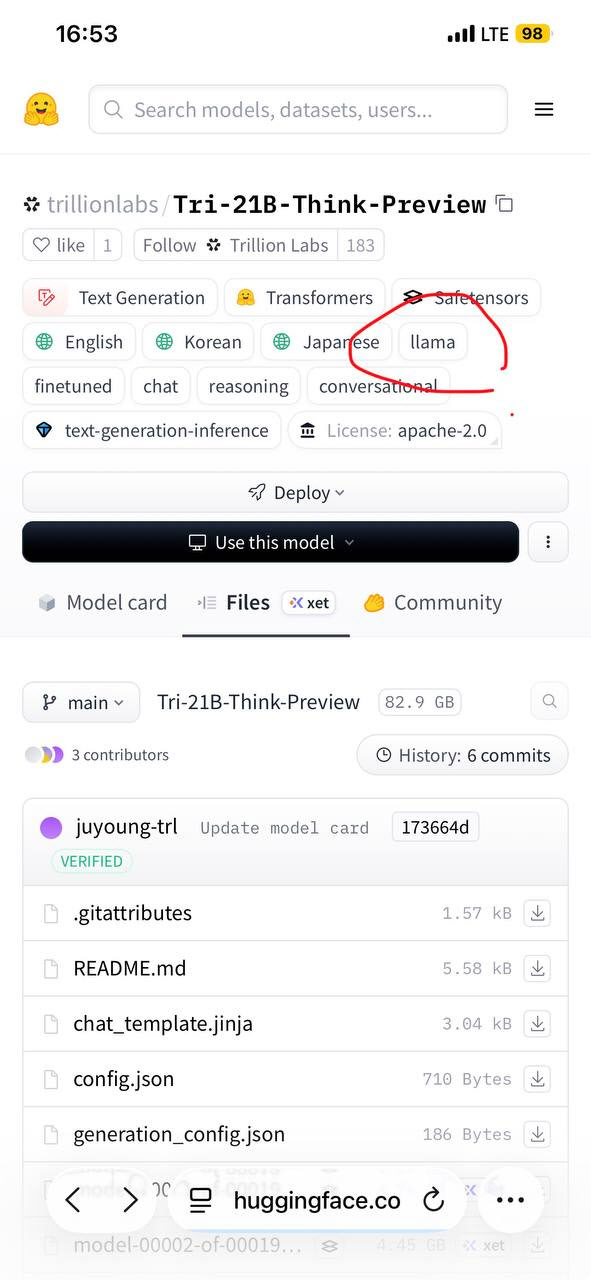

이에 대해 모티프 측은 Tri-21B가 추론(inference) 코드 일부를 차용한 수준이 아니라, 모델 구조와 구현 전반이 라마 기반이라는 취지로 반발했다. 모티프 측은 “AAII(Artificial Analytics) 제출 코드가 라마 그대로(architectures; LlamaForCausalLM)”라고 주장하며 허깅페이스 자료를 근거로 들었다. 반면 트릴리온랩스는 “독자성의 핵심은 아키텍처 자체보다 프롬스크래치로 가중치를 학습했는지에 있다”며 “이를 입증하는 자료를 제출했다”고 반박했다.

|

모티프 측은 Tri-21B 허깅페이스 저장소에 초기부터 ‘Llama finetuned’ 표기가 있었던 점을 들어 단순 표기 실수로 보기 어렵다는 입장이다. 또 독자 모델이라면 모델링(modeling) 코드가 있어야 하는데 초기에는 없었고 이후 추가된 정황이 있다고 주장했다. 아울러 허깅페이스 및 AAII 관련 기록을 지우거나 정리하는 움직임이 있었다고도 언급했다.

아울러 트릴리온이 설명 문구를 급히 수정했다고도 했다. 예컨대 “vLLM에서 바로 사용 가능” 같은 표현이 삭제되고 “아직 지원되지 않으며 향후 지원”으로 바뀐 정황을 근거로 들었다. 모티프 고위 관계자는 “추론 코드만 가져다 쓴 수준이 아니라 라마를 베낀 모델”이라고 비판했다. “라마에 21B가 없다”는 트릴리온의 주장에 대해서는 “동일 아키텍처에서 설정(config) 변경으로 다양한 크기의 모델을 만들 수 있다”는 점을 들어 반박했다. 토크나이저가 다르다는 트릴리온 설명 역시 “독자성의 결정적 증거가 될 수 없다”고 밝혔다. 토크나이저는 문장을 모델이 처리할 수 있는 단위(토큰)로 쪼개는 규칙과 사전 체계를 뜻한다.

|

트릴리온랩스 고위 관계자는 Tri-21B가 2025년 7월 공개됐고 프롬스크래치로 가중치를 학습한 독자 모델이라는 점을 재차 강조했다. 그는 “로스 커브 등 관련 자료를 과기부에 제출했다”고도 밝혔다. AAII 리더보드에 오른 Tri-21B-Think는 기존 Tri-21B를 추가 학습해 강화학습 기반 ‘Thinking’ 능력을 탑재한 버전이라고 했다.

트릴리온은 2025년 7월 당시 확산 편의를 위해 라마의 추론 코드를 활용한 점은 인정하면서도, 이는 업스테이지가 Solar-Open-100B에서 GLM 기반 추론 코드를 활용한 사례와 같은 맥락이라고 주장했다. 트릴리온랩스 고위 관계자는 “라마 시리즈에는 애초에 21B 규모가 존재하지 않는다. 그래서 저희 Tri-21B는 독자 아키텍처가 확실하게 맞다”면서 “라마와 호환가능하게 만들었기 때문에 라마를 참고했고, 확산의 편의를 위해 추론코드도 가져다 쓴게 맞다”고 밝혔다. 이어 “애초에 토크나이저도 다르고, 라마에는 존재하지도 않는 21B 규모의 모델을 새로 설계해서 만든 것이어서 당연히 독자 모델”이라고 반박했다.

제3자 시각 “토크나이저는 결정적 증거 아냐…룰 정합성이 핵심”

익명을 요구한 한 교수는 “토크나이저(식재료)가 다르다고 해서 모델(조리법)을 베끼지 않았다는 증거가 되지는 않는다”고 봤다. 동시에 “21B가 라마에 없다는 주장은 독자 개발 논리로 제시할 수 있다”고 부연했다.

그는 “더 근본적으로는 트릴리온이 문제로 인정될 경우 업스테이지 전례 역시 같은 잣대에 오를 수 있어, 정부가 정리한 기준과의 정합성이 핵심 변수로 떠오를 수 있다”고 덧붙였다.

이번 공방은 단순한 경쟁 기업 간 신경전을 넘어, 독파모 평가에서 ‘독자성’ 기준을 어디에 둘지로 이어지고 있다. 코드 차용의 허용 범위, 전례 적용의 일관성 여부 등이 정리되지 않으면 2차전 심사 과정에서도 유사 논란이 반복될 가능성이 있다.

![“얼굴 가리고 피투성이 딸 질질 끌고가”…팔순 아버지의 눈물[그해 오늘]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/02/PS26022000001t.jpg)